O Superior Tribunal de Justiça estabeleceu limites ao uso de inteligência artificial em processos criminais.

(Imagem: gerado por IA)

O Superior Tribunal de Justiça estabeleceu limites ao uso de inteligência artificial em processos criminais.

(Imagem: gerado por IA)

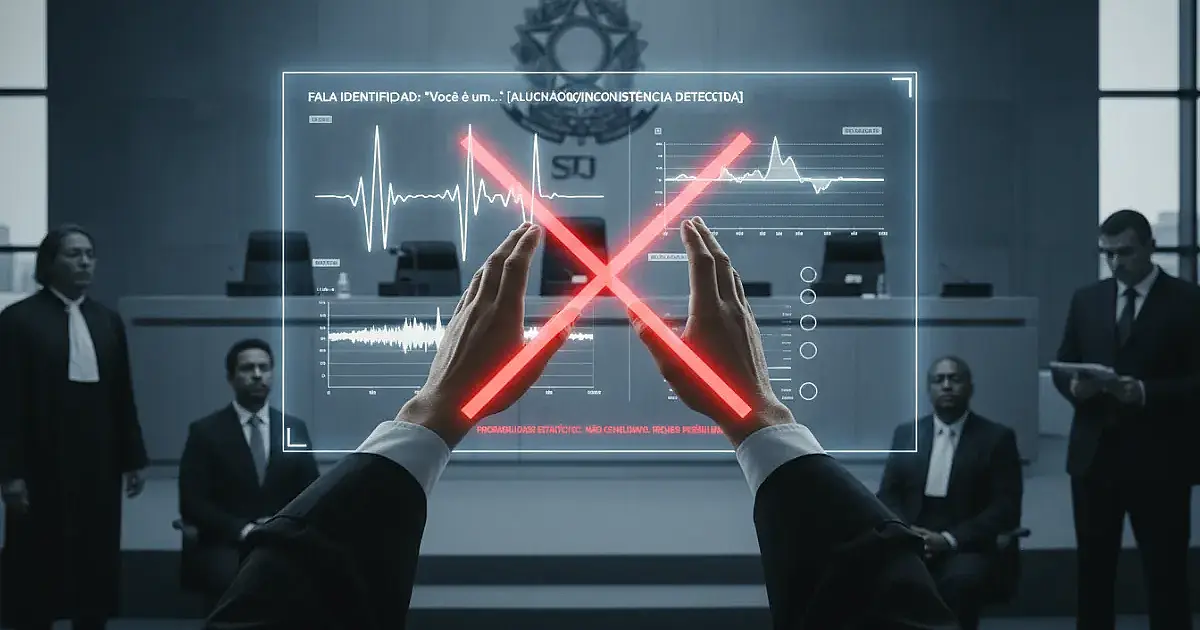

O Superior Tribunal de Justiça (STJ) acaba de erguer uma barreira histórica contra o uso desregulado da inteligência artificial no sistema criminal brasileiro. Em uma decisão que define um precedente crucial para o Direito moderno, a Quinta Turma do tribunal rejeitou a utilização de relatórios gerados por ferramentas de IA generativa como prova em uma ação penal. O caso, que envolve uma acusação de injúria racial, coloca sob os refletores a confiabilidade das novas tecnologias no ambiente jurídico.

A decisão foi fundamentada no risco das chamadas "alucinações", quando algoritmos como o Gemini, do Google, ou o Perplexity criam informações falsas com uma aparência perturbadoramente real. Para o ministro Reynaldo Soares da Fonseca, relator do processo, confiar cegamente nessas ferramentas sem o crivo de peritos oficiais pode comprometer a justiça e os direitos fundamentais dos réus.

Na prática, isso muda mais do que parece. A partir de agora, o uso de inteligência artificial em investigações policiais deve ser visto apenas como um ponto de partida, e nunca como uma prova conclusiva para sustentar uma denúncia. Mas o impacto vai além da técnica jurídica: trata-se de como a sociedade lida com a verdade na era digital.

O que está por trás da decisão do tribunal

O episódio que motivou o julgamento ocorreu em São José do Rio Preto, durante uma partida de futebol. O vice-prefeito da cidade foi acusado de proferir ofensas raciais contra um segurança no estacionamento do estádio. O Ministério Público baseou sua denúncia em um relatório policial que utilizou IA para analisar o áudio de um vídeo da discussão, concluindo que o xingamento ocorreu.

O problema central surgiu quando o Instituto de Criminalística realizou a perícia oficial. Diferente da inteligência artificial, os peritos humanos, utilizando análises fonéticas e acústicas rigorosas, não conseguiram confirmar a presença da palavra ofensiva citada na acusação. O contraste gritante entre a "percepção" da tecnologia e a ciência forense tradicional gerou o impasse que chegou à corte superior.

Ao analisar o conflito, o ministro Fonseca destacou que esses sistemas operam com base em probabilidades e padrões estatísticos. Isso significa que, muitas vezes, a IA "preenche lacunas" de forma lógica, mas não necessariamente verdadeira. É aqui que reside o perigo: a probabilidade matemática não substitui a certeza exigida no Direito Penal.

Como isso afeta o futuro das investigações no Brasil

A exclusão do relatório dos autos não encerra o caso, mas obriga a Justiça a reavaliar a denúncia sem considerar as conclusões da inteligência artificial. Essa medida envia um recado claro às polícias e aos órgãos de acusação: a tecnologia é uma aliada potente, mas não é infalível. A soberania continua sendo da perícia técnica humana e devidamente fundamentada.

E é aqui que está o ponto central. À medida que o uso de ferramentas generativas se populariza, a tentação de acelerar processos investigativos aumenta consideravelmente. No entanto, o STJ reafirmou que a eficiência não pode atropelar a segurança jurídica. A "aparência de fidedignidade" mencionada pelo ministro é um aviso sobre a sofisticação das máquinas em enganar até mesmo olhos e ouvidos atentos.

Este julgamento marca o início de uma nova era de debates sobre ética e tecnologia nos tribunais brasileiros. Enquanto a legislação ainda caminha para regulamentar a IA no país, o Judiciário começa a estabelecer os limites necessários para proteger o cidadão de erros algorítmicos que, no limite, podem custar a liberdade de um inocente.